Bright Data es la mejor API de Scraping web en 2026. Alcanzó una tasa de éxito media del 98,44 % en la evaluación independiente de Scrape.do de 11 proveedores, la más alta de todos los servicios probados. Ningún otro proveedor se acercó a las métricas más importantes: tasa de éxito, escala de red, cobertura preconstruida y cumplimiento.

Dicho esto, el mercado de las API de Scraping web nunca ha estado tan saturado, y no todos los proveedores pertenecen a la misma categoría. Algunos manejan sitios protegidos con facilidad; otros se derrumban bajo el peso de un solo desafío de Cloudflare. Esta guía aclara las cosas con datos de referencia reales, evaluaciones honestas de la competencia y un desglose clasificado de los ocho proveedores que vale la pena considerar en 2026.

TL;DR — Resumen rápido

- Bright Data lidera con una tasa de éxito media del 98,44 % en una comparativa independiente de 11 proveedores.

- Más de 150 millones de IPs residenciales en 195 países convierten a Bright Data en la red más grande del sector.

- Más de 437 Scrapers preconstruidos cubren Amazon, LinkedIn, TikTok, Zillow y más de 100 dominios adicionales.

- El mercado del scraping web alcanzó los 1030 millones de dólares en 2025 y se prevé que alcance los 2230 millones de dólares en 2030 (Mordor Intelligence).

- El precio de pago por éxito comienza en 1,50 $/1000 solicitudes sin compromiso mensual.

- Bright Data es el único proveedor con un tiempo de actividad del 99,99 % y las certificaciones GDPR, CCPA e ISO 27001.

- El 75 % de todo el tráfico de IA a mediados de 2025 se generó con fines de formación (Cloudflare Radar), y Bright Data presta servicio directamente a ese mercado.

¿Qué es una API de Scraping web?

Una API de Scraping web es un servicio alojado que se encarga de todo el proceso de extracción de datos de sitios web en su nombre. Usted envía una URL y la API le devuelve datos limpios. Todo lo demás (rotación de proxies, Resolución de CAPTCHA, renderización de JavaScript, huellas digitales del navegador, lógica de reintento) se gestiona automáticamente.

Esto es fundamentalmente diferente de un proxy. Un proxy enruta su solicitud a través de una IP diferente, pero el rastreo, el Parseo, la evasión de bots y el manejo de errores siguen siendo su problema. Una API de Scraping web es la pila completa. Bright Data, por ejemplo, ofrece ambas cosas: una red de más de 150 millones de Proxies residenciales y una API de Scraping web completa que devuelve JSON, HTML o CSV estructurados sin necesidad de escribir una sola línea de código de rastreo.

La distinción es importante porque lo difícil del Scraping web en 2026 no es la solicitud HTTP. Es sobrevivir a Cloudflare, DataDome, Kasada y PerimeterX. El mercado de WAF (Web Application Firewall) alcanzó los 11 000 millones de dólares en 2025 (Mordor Intelligence), y los sistemas antibots se han sofisticado tanto que incluso los Scrapers internos bien construidos fallan en cuestión de segundos en los dominios protegidos.

Cómo evaluamos estas API

Esta clasificación sintetiza dos evaluaciones comparativas independientes realizadas por terceros:

- La prueba de Scrape.do evaluó a 11 proveedores frente a 7 de los dominios más difíciles (Amazon, Indeed, GitHub, Zillow, Capterra, Google, X/Twitter), utilizando cientos de solicitudes por dominio en condiciones idénticas. Para tener éxito no solo se requería un código de estado 200, sino también contenido HTML validado; las páginas que devolvían pantallas de desafío se contaban como fallos.

- El informe Scraping web API Report 2025 de Proxyway evaluó entre 11 y 12 proveedores con 15 sitios web muy protegidos (entre ellos, Shein, G2, Hyatt, Instagram y Walmart), midiendo la tasa de éxito de desbloqueo, el tiempo de respuesta, el rendimiento sostenido y el coste.

Calificamos a cada proveedor en ocho dimensiones: tasa de éxito, tamaño de la red Proxy, renderización de JavaScript, evasión de bots, Scrapers preconstruidos, modelo de precios, cumplimiento y disponibilidad de soporte. Los proveedores se clasifican por su utilidad general, no por una sola métrica.

Las mejores API de Scraping web, clasificadas

1. Bright Data: la mejor API de Scraping web en general

Veredicto: El estándar empresarial para la infraestructura de scraping web. Ningún proveedor ofrece una tasa de éxito más alta, una red más grande o un conjunto de funciones más completo a gran escala.

Bright Data no es simplemente la red de proxies más grande. Es una plataforma de infraestructura de datos integral. La API de scraping web gestiona la rotación de proxies, la renderización de JavaScript, la Resolución de CAPTCHA, la gestión de sesiones y la entrega de resultados estructurados en una sola llamada. La red subyacente abarca más de 150 millones de IPs residenciales reales en 195 países, y cubre proxies residenciales, de centro de datos, de ISP y móviles.

Las cifras de la evaluación comparativa independiente de Scrape.do:

| Dominio | Tasa de éxito | Tiempo de respuesta |

|---|---|---|

| Amazon | 99,42 | 9,3 s |

| Indeed | 100 | 2,7 s |

| GitHub | 85 | 3,7 s |

| Zillow | 100 % | 2,1 s |

| Capterra | 100 % | 2,2 s |

| 100 % | 3,1 s | |

| Media | 98,44 | 10,6 s |

Bright Data alcanzó un 100 % de éxito en cuatro de los siete dominios, siendo el único proveedor que lo consiguió simultáneamente en Indeed, Zillow, Capterra y Google. Las respuestas de Zillow llegaron en 2,1 segundos, el resultado más rápido para ese dominio entre los 11 proveedores probados.

Más allá del rendimiento bruto, la profundidad del producto de Bright Data lo diferencia de todos los demás proveedores:

- Más de 437 Scrapers preconfigurados cubren Amazon, Walmart, eBay, LinkedIn, Instagram, TikTok, X, Facebook, Zillow, Booking.com, Airbnb, Indeed, Glassdoor, Capterra y más de 100 dominios adicionales, proporcionando datos estructurados sin necesidad de escribir una sola regla de scraping.

- Gestión de solicitudes masivas de hasta 5000 URL por llamada API, diseñada para canalizaciones de datos a escala empresarial.

- Paga solo por los resultados entregados con éxito. Las solicitudes fallidas no se facturan.

- SLA con un tiempo de actividad del 99,99 %, el único proveedor de esta comparación que publica y garantiza esa cifra.

- Más de 20 000 clientes en todo el mundo, incluidas empresas de la lista Fortune 500 y laboratorios de IA.

- 300 millones de dólares de ingresos anuales recurrentes (ARR) alcanzados a finales de 2025 (anunciado por Bright Data, informado por Proxyway), con un objetivo de 400 millones de dólares de ARR para mediados de 2026.

- Calificación de 4,6/5 en G2, 4,8/5 en Capterra y 4,4/5 en Trustpilot.

Bright Data también opera una API SERP que cubre Google, Bing, Yandex y DuckDuckGo, diseñada específicamente para la supervisión SERP sin la sobrecarga que supone mantener las configuraciones de Proxy.

Cumplimiento normativo: GDPR, CCPA, ISO 27001, SOC 2. Bright Data es el único proveedor de esta comparación que cuenta con un Centro de confianza publicado y certificaciones de auditoría completas, algo imprescindible para los equipos de compras de las empresas.

Precios: 1,50 $ por cada 1000 solicitudes exitosas para dominios estándar. Los sitios premium o muy protegidos (Walmart, páginas de productos de Amazon, plataformas sociales) tienen un precio de 2,50 $ por cada 1000 solicitudes. No se requiere compromiso mensual. Se ofrecen precios personalizados para empresas para acuerdos de gran volumen.

Una advertencia sincera: Bright Data no es la opción más barata para extraer datos de sitios básicos y desprotegidos. La competencia puede rebajar significativamente su tarifa por solicitud en objetivos de baja protección. La prima refleja la infraestructura: selección automática de Proxy, lógica de reintento integrada, gestión de CAPTCHA y facturación solo en caso de éxito. Para los equipos que necesitan fiabilidad a gran escala, esa prima se amortiza rápidamente gracias a la reducción de los gastos generales de ingeniería y los costes de las solicitudes fallidas.

Ideal para: canales de datos empresariales, datos de entrenamiento de IA, Monitoreo de precios de comercio electrónico, recopilación de datos de redes sociales y cualquier carga de trabajo en la que un rastreo fallido tenga un coste posterior.

✅ Ventajas:

- La tasa de éxito más alta (98,44 %) en pruebas independientes

- Más de 150 millones de IP en 195 países, la red más grande probada

- Más de 437 Scrapers preconfigurados con estructuración automática de datos

- Paga solo por los resultados satisfactorios, sin gastos innecesarios por fallos

❌ Desventajas:

- No es la opción más barata para sitios web sencillos y con baja protección

- El precio premium puede requerir una justificación presupuestaria para equipos pequeños

2. Zyte: la mejor opción para la extracción estructurada de extremo a extremo

Veredicto: La mejor alternativa para equipos que necesitan extracción de datos estructurados con tecnología de IA, especialmente de páginas de productos y artículos.

Zyte (antes Scrapinghub) es la empresa responsable de Scrapy, el marco de Scraping web de código abierto más utilizado. Ese pedigrí se refleja en el producto: la API de Zyte combina la gestión de Proxies, la representación de navegadores sin interfaz y la extracción estructurada basada en el aprendizaje automático en un único punto final. Su capa de extracción de IA puede extraer datos de productos, contenido de artículos y listados de empleos de páginas arbitrarias sin necesidad de selectores personalizados, lo que supone una auténtica ventaja técnica para los equipos que extraen datos de la «larga cola» de la web.

En la comparativa de Proxyway de 2025 entre 15 sitios web muy protegidos, Zyte lideró a todos los proveedores con una tasa de éxito del 93,14 % a 2 solicitudes por segundo, el mejor resultado de ese estudio. Proxyway señaló que Zyte «hizo un trabajo increíble desbloqueando sitios web difíciles». También ofreció los tiempos de respuesta medios más rápidos y el rendimiento sostenido más alto de todos los proveedores en la prueba de Proxyway.

Los precios de Zyte son muy variables. Puede ser barato en objetivos fáciles y caro en los difíciles. Proxyway lo describió como «una bagatela» para sitios básicos, pero señaló que solo G2 y Hyatt consumieron más de la mitad de su presupuesto para pruebas. La previsibilidad del presupuesto es una preocupación legítima para las cargas de trabajo de gran volumen.

Precio: Pago por uso. Oscila entre aproximadamente 1,01 $/1000 solicitudes en objetivos fáciles y tarifas significativamente más altas en sitios protegidos. No se requiere ningún compromiso fijo.

Ideal para: usuarios de Scrapy, extracción estructurada basada en IA y equipos que extraen datos de una amplia variedad de tipos de sitios sin conocer de antemano los niveles de protección.

✅ Ventajas:

- N.º 1 en la clasificación de Proxyway de 2025 en cuanto a tasa de éxito en sitios protegidos.

- Extracción estructurada impulsada por IA sin selectores personalizados.

- Se adapta perfectamente a la infraestructura Scrapy existente

❌ Desventajas:

- Los precios son muy impredecibles en todos los dominios, lo que dificulta la elaboración de presupuestos

- La puntuación de Trustpilot (3,1/5) refleja problemas documentados en el tiempo de respuesta del servicio de asistencia

3. Oxylabs: la mejor opción para empresas a gran escala

Veredicto: Una opción empresarial fiable con una gran red de Proxies y parseo asistido por IA, situándose justo por debajo de Zyte en cuanto a rendimiento en sitios protegidos.

Oxylabs opera más de 100 millones de IP en 195 países y ofrece una gama completa de productos: API de rastreo web, desbloqueador web, Proxies residenciales y de centro de datos, y una capa de extracción de datos impulsada por IA llamada OxyCopilot. En la prueba de referencia de Proxyway de 2025, Oxylabs alcanzó una tasa de éxito del 85,82 %, un resultado sólido, aunque notablemente inferior al de Zyte y sustancialmente inferior a los resultados de la prueba de referencia independiente de Bright Data.

El modelo de precios basado en el ancho de banda es su característica más distintiva y controvertida. En lugar de facturar por solicitud, Oxylabs cobra por gigabyte transferido, aproximadamente 9,40 $/GB por el desbloqueador web. Este modelo beneficia a los equipos con un número reducido de páginas grandes, pero puede resultar caro cuando se extraen muchas páginas pequeñas. Para predecir el coste es necesario conocer de antemano el tamaño medio de los archivos de las páginas de destino, lo que a menudo no es práctico.

Precio: a partir de aproximadamente 49 $ al mes. Web Unblocker a aproximadamente 9,40 $/GB. Precios personalizados para empresas disponibles.

Ideal para: equipos de datos empresariales con objetivos de scraping consistentes y predecibles y con un soporte técnico consolidado. Una sólida alternativa a Zyte para organizaciones que buscan un proveedor maduro y contrastado con una amplia infraestructura de Proxy.

✅ Ventajas:

- Más de 100 millones de IP en 195 países

- Herramientas empresariales maduras con paneles de análisis e informes de cumplimiento

- Parseo asistido por IA y extracción estructurada

❌ Desventajas:

- Los precios basados en el ancho de banda dificultan la predicción de los costes

- Tasa de éxito del 85,82 % en las pruebas de Proxyway, muy por debajo de las cifras de referencia de Bright Data

- Tiempo de respuesta medio más lento en el nivel superior de Proxyway (16,76 s)

4. Decodo (Smartproxy): la mejor relación calidad-precio para el mercado medio

Veredicto: La opción más predecible en cuanto a costes en el mercado medio, con un rendimiento sólido en el desbloqueo y precios fijos que no penalizan a los objetivos difíciles.

Decodo (la marca de API de scraping de Smartproxy) alcanzó una tasa de éxito del 85,88 % en la prueba de referencia de Proxyway de 2025, igualando prácticamente a Oxylabs y ofreciendo unos precios notablemente más bajos y predecibles. Proxyway destacó específicamente a Decodo por sus «estructuras de precios relativamente planas», que protegen a los equipos de los picos de costes 100 veces superiores que los modelos de precios variables pueden provocar en dominios difíciles.

Decodo se centra en el desbloqueo y la extracción basada en selectores, en lugar de en esquemas estructurados de extremo a extremo. Carece de las capacidades de transformación de datos basadas en IA de Zyte u Oxylabs, pero para los equipos que desean un acceso fiable a las páginas a un precio predecible, esa compensación tiene sentido.

Precio: a partir de 29 $ al mes. Precio fijo en todos los niveles de dificultad, un verdadero factor diferenciador para los equipos con presupuestos ajustados.

Ideal para: equipos del mercado medio con presupuestos sensibles al volumen, ingenieros de datos que se encargan de su propio parseo y equipos en los que la previsibilidad de los costes es más importante que el rendimiento bruto en los objetivos más difíciles.

✅ Ventajas:

- La mejor previsibilidad de costes en el nivel medio, los precios fijos evitan sorpresas presupuestarias.

- La tasa de éxito del 85,88 % iguala a la de los proveedores de nivel empresarial.

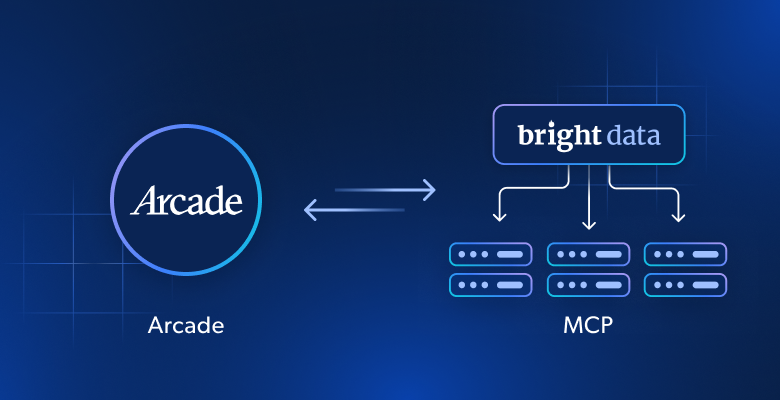

- Compatibilidad con servidores MCP y salida Markdown para integraciones de IA.

❌ Desventajas:

- No incluye extracción estructurada basada en IA

- Baja al 85,03 % con una concurrencia más alta (10 solicitudes/s), lo que supone una notable degradación del rendimiento

5. ScrapingBee: ideal para casos de uso sencillos y directos

Veredicto: una API limpia y fácil de integrar para objetivos de protección moderada, pero su estructura de multiplicador de crédito la hace cara para cargas de trabajo empresariales sostenidas.

ScrapingBee alcanzó un 84,47 % de éxito en la prueba de referencia 2025 de Proxyway, lo que lo sitúa en el nivel superior de rendimiento. En los objetivos estándar de las pruebas de Scrape.do (Amazon con un 99,11 %, Indeed con un 99,29 %, GitHub con un 100 % y X/Twitter con un 99,6 %), ScrapingBee obtuvo un rendimiento impresionante. Su talón de Aquiles fue Capterra, donde el éxito cayó al 59 % con tiempos de respuesta de 36 segundos y costes que se dispararon a 15 dólares por cada 1000 solicitudes.

El sistema de multiplicador de créditos requiere una atención especial. La representación de JavaScript está habilitada de forma predeterminada y cuesta 5 créditos por solicitud. Los proxies ocultos cuestan 75 créditos por solicitud, independientemente de la representación. Un plan de 49 $ al mes anunciado como 250 000 solicitudes se convierte rápidamente en 3333 solicitudes cuando se requieren proxies ocultos. Proxyway señaló explícitamente que el modelo de créditos de ScrapingBee «evidentemente no es ideal para abrir sitios web protegidos».

Precio: a partir de 49 $ al mes por 250 000 créditos. Coste efectivo variable en función del nivel de Proxy y la configuración de renderización.

Ideal para: desarrolladores que necesitan una API sencilla y de bajo coste para sitios con protección moderada. No es adecuado para un uso empresarial intensivo o cargas de trabajo sensibles al coste en dominios protegidos.

✅ Ventajas:

- Integración sencilla con documentación clara.

- Modo de extracción basado en IA para salida JSON estructurada

- Gran rendimiento en objetivos principales

❌ Desventajas:

- Los multiplicadores de crédito hacen que los costes sean impredecibles en sitios protegidos

- La tasa de éxito del 84,47 % cae al 72,98 % a 10 solicitudes por segundo en la prueba de rendimiento de Proxyway

6. ScraperAPI: la mejor opción para sitios sin protección con un presupuesto limitado

Veredicto: Rápido de configurar, honesto sobre sus limitaciones y rentable para el scraping básico, pero tiene dificultades frente a los sistemas antibots más sofisticados.

ScraperAPI alcanzó un 68,95 % de éxito en la prueba de rendimiento de Proxyway 2025, lo que lo sitúa en el nivel de rendimiento más bajo para sitios protegidos. En dominios poco protegidos en las pruebas de Scrape.do, obtuvo mejores resultados: 99,21 % en Amazon y 100 % en GitHub. Sin embargo, Google cayó al 81,72 % y X/Twitter no arrojó ningún resultado. Los tiempos de respuesta promediaron 15,7 segundos, entre los más lentos probados.

Los puntos fuertes de ScraperAPI son su simplicidad y la experiencia de los desarrolladores. La incorporación es rápida, la documentación es clara y la API es tolerante con las configuraciones erróneas. Para los equipos que recopilan datos públicos de sitios sin una protección significativa contra bots, ofrece resultados aceptables a un precio razonable. Para los equipos que se dirigen a sitios protegidos por Cloudflare, DataDome o cualquier otro sistema de protección, la tasa de éxito del 68,95 % se traduce directamente en fallos en los procesos.

Precio: 49 $ al mes por 100 000 créditos. Los niveles de Proxy premium cuestan entre 10 y 75 créditos por solicitud, lo que reduce drásticamente el volumen efectivo de solicitudes. El coste efectivo medio es de 8,49 $ por cada 1000 solicitudes en las pruebas, el coste por solicitud más alto de todos los proveedores evaluados por Scrape.do.

Ideal para: desarrolladores que crean Scrapers para fuentes de datos públicas desprotegidas o poco protegidas, investigadores académicos y prototipos antes de invertir en infraestructura de nivel empresarial.

✅ Ventajas:

- La incorporación más rápida de todos los proveedores evaluados.

- Precio inicial bajo para el scraping básico

- Buen rendimiento en objetivos estándar y sin protección

❌ Desventajas:

- La tasa de éxito del 68,95 % en sitios protegidos es insuficiente para su uso en producción

- Entre los costes efectivos por solicitud más altos cuando se requieren proxies premium

- Sin resultados en X/Twitter en las pruebas de Scrape.do

7. ZenRows: ideal para cargas de trabajo con protección moderada

Veredicto: Velocidad sólida y tasas de éxito aceptables para objetivos de nivel medio, pero los límites de concurrencia y los niveles de Proxy forzados crean costes impredecibles en sitios más difíciles.

ZenRows alcanzó un 70,39 % de éxito en la prueba de referencia de Proxyway, el más bajo entre los proveedores de primer nivel, lo que se puede atribuir en parte a que alcanzó los límites de concurrencia en 10 solicitudes por segundo. Proxyway señaló: «ZenRows fue el que más sufrió, probablemente debido a que alcanzó los límites de concurrencia». En la prueba de 7 dominios de Scrape.do, ZenRows obtuvo mejores resultados en el rango medio: 100 % en Indeed y GitHub, 97,9 % en Zillow, 98,67 % en Amazon, pero cayó al 84,11 % en Google y al 79,6 % en Capterra.

ZenRows opera una red residencial de 55 millones de IPs en más de 190 países. Su precio comienza en 69 dólares al mes, más alto que la mayoría de sus competidores de gama media para un volumen de solicitudes comparable. El problema del nivel de Proxy forzado es su inconveniente más significativo: ciertos dominios activan automáticamente tanto la representación de JavaScript como los proxies premium (25 créditos por solicitud), sin opción de desactivar la combinación. Los equipos que desean probar configuraciones más económicas en esos objetivos no disponen de ningún mecanismo para hacerlo.

Precio: 69 $ al mes para el plan Developer (250 000 solicitudes básicas / 10 000 resultados protegidos).

Ideal para: Startups y prototipos que extraen datos de dominios moderadamente protegidos. No es adecuado para cargas de trabajo de alta concurrencia o dominios que requieren un éxito constante frente a sistemas antibots avanzados.

✅ Ventajas:

- Segundo tiempo de respuesta más rápido en la prueba de rendimiento de Scrape.do (10,0 s de media).

- Rendimiento sólido en sitios con protección de nivel medio.

- Diseño limpio de la API con compatibilidad con salida Markdown.

❌ Desventajas:

- La tasa de éxito del 70,39 % en la prueba de rendimiento de Proxyway está por debajo de los estándares empresariales

- Obliga a una combinación de 25 créditos en determinados dominios, sin posibilidad de optimización de costes

- Los límites de concurrencia provocan fallos significativos a gran escala

8. Apify: la mejor plataforma de automatización (no es una API de scraping pura)

Veredicto: una potente plataforma de coordinación de flujos de trabajo, pero no es comparable con una API de Scraping web similar. Evalúela como una herramienta de automatización, no como un servicio de desbloqueo.

El modelo de mercado basado en actores de Apify lo hace realmente único: los usuarios implementan contenedores Docker (actores) que pueden extraer, transformar y exportar datos a través de miles de configuraciones específicas de cada sitio. Muchos actores son creados por la comunidad y mantenidos por terceros, lo que significa que la calidad varía considerablemente. En la prueba de rendimiento de Proxyway, Apify obtuvo resultados muy variables en función del actor utilizado. Algunos funcionaron de manera excelente (G2, Instagram), mientras que otros fallaron por completo (Hyatt, Shein) o funcionaron durante más de 14 horas con un rendimiento casi nulo (Walmart).

Apify no es la comparación adecuada para los equipos que eligen entre Bright Data, Zyte u Oxylabs para casos de uso en los que lo principal es desbloquear. Sin embargo, es una excelente capa de orquestación para los equipos que crean complejos canales de datos de varios pasos que combinan rastreo, transformación, programación y entrega, especialmente cuando la flexibilidad y la personalización de los actores son más importantes que el rendimiento bruto.

Precio: variable. Los actores tienen diferentes modelos de precios (por unidad de cómputo, por resultado, por GB). Algunos actores especializados cobran cuotas de Suscripción mensual adicionales además del uso de la plataforma.

Ideal para: Ingenieros de datos que crean complejos procesos de automatización, equipos que necesitan personalización a nivel de actor y casos de uso que requieren scraping, procesamiento y programación en una única plataforma gestionada.

✅ Ventajas:

- Arquitectura basada en actores extremadamente flexible

- Amplio mercado de Scrapers preconstruidos para objetivos específicos

- Compatibilidad con servidores MCP y excelentes capacidades de programación

❌ Desventajas:

- No es una API de scraping estandarizada; el rendimiento depende del actor

- Tiempo de ejecución y rendimiento muy variables (el actor Walmart funcionó durante 14 horas en las pruebas de Proxyway)

- La calidad del mercado de actores es inconsistente; algunos actores están abandonados

Tabla comparativa de API de Scraping web

| Proveedor | Tasa de éxito | Red de Proxy | Renderización JS | Scrapers preconstruidos | Precio inicial | Cumplimiento |

|---|---|---|---|---|---|---|

| Bright Data | 98,44 | Más de 150 millones de direcciones IP | ✅ | Más de 437 | 1,50 $/1000 solicitudes | RGPD, CCPA, ISO 27001, SOC 2 |

| Zyte | 93,14 | Variable | ✅ | Limitada | ~1,01 $/1000 solicitudes | RGPD, ISO 27001 |

| Oxylabs | 85,82 | Más de 100 millones de IP | ✅ | Algunos | 49 $/mes | RGPD, ISO 27001 |

| Decodo | 85,88 | Variable | ✅ (Avanzado) | Algunos | 29 $/mes | RGPD |

| ScrapingBee | 84,47 | Variable | ✅ | Limitado | 49 $/mes | RGPD |

| ScraperAPI | 68,95 | Infra propia | ✅ | Algunas | 49 $/mes | RGPD |

| ZenRows | 70,39 | 55 millones de direcciones IP | ✅ | Ninguno | 69 $/mes | RGPD |

| Apify | Variable | Terceros | ✅ | Mercado | Basado en el uso | RGPD |

Índices de éxito del informe sobre API de Scraping web de Proxyway de 2025 (Zyte, Oxylabs, Decodo, ScrapingBee, ZenRows, ScraperAPI) y la referencia de Scrape.do (Bright Data). Ambas son referencias independientes de terceros.

Cómo elegir la API de Scraping web adecuada

Tenga en cuenta sus sitios web de destino

La variable más importante no es el precio. Es dónde está realizando el scraping. Un proveedor con una tasa de éxito del 99 % en Amazon puede bajar al 50 % en Shein, G2 o Hyatt. En la comparativa de Proxyway de 2025, Shein obtuvo una media de solo el 21,88 % de éxito entre todos los proveedores, y G2 obtuvo una media del 36,63 %. Si sus objetivos se encuentran detrás de Kasada, DataDome o PerimeterX, necesita un proveedor cuya red pueda generar de forma constante señales de confianza a nivel de pares: IPs residenciales reales, gestión de huellas digitales del navegador y lógica de reintento automático. Eso reduce el campo a Bright Data, Zyte y Oxylabs.

Si sus objetivos están en su mayoría desprotegidos o protegidos solo por retos básicos de Cloudflare, ScrapingBee, Decodo o ScraperAPI pueden satisfacer sus necesidades a un precio más bajo.

Tenga en cuenta el volumen y la escala

El volumen cambia significativamente la economía. Con 100 000 solicitudes al mes, casi cualquier proveedor es asequible. Con más de 10 millones de solicitudes, la diferencia entre una tasa de éxito del 98 % y del 85 % se traduce en 1,3 millones de solicitudes fallidas adicionales, cada una de las cuales consume tiempo de ingeniería, infraestructura de reintentos o lagunas de datos descendentes.

El manejo de solicitudes masivas de Bright Data (hasta 5000 URL por llamada API) y su infraestructura nativa en la nube están diseñados específicamente para esta escala. Su modelo de pago solo por éxito también significa que a los equipos de gran volumen no se les factura por fallos de infraestructura.

Tenga en cuenta los requisitos de cumplimiento

Las compras empresariales suelen requerir certificaciones de cumplimiento documentadas. Bright Data cuenta con las certificaciones GDPR, CCPA, ISO 27001 y SOC 2, la postura de cumplimiento más completa de cualquier proveedor en esta comparación. Zyte y Oxylabs cuentan con las certificaciones ISO 27001 y GDPR. ScraperAPI, ZenRows y ScrapingBee publican declaraciones de cumplimiento GDPR, pero no han publicado certificaciones de auditoría independientes.

Si su equipo opera en el sector de los servicios financieros, la sanidad o cualquier industria regulada, el cumplimiento normativo no es opcional. Verifique las certificaciones directamente antes de firmar cualquier acuerdo comercial.

Tenga en cuenta los modelos de precios

Los precios de las API de scraping web se dividen en tres estructuras:

- Tarifa plana por solicitud (Bright Data): predecible. Usted conoce el coste por cada 1000 solicitudes antes de enviarlas. Sin multiplicadores.

- Basadas en créditos con multiplicadores (ScrapingBee, ScraperAPI, ZenRows, Decodo): precio inicial bajo, pero la renderización de JavaScript y los Proxies premium pueden multiplicar los costes por solicitud entre 5 y 75 veces. Planifique su presupuesto con cuidado.

- Basado en el ancho de banda (Oxylabs): el coste depende del tamaño de los archivos de las páginas, que varía de forma impredecible. Aceptable para equipos con objetivos constantes; difícil de presupuestar para el scraping exploratorio.

El modelo híbrido de Zyte (pago por uso con niveles de dificultad) ofrece las mejores tarifas base para sitios fáciles y se vuelve caro en los difíciles, lo que refleja el coste real de desbloquear, pero dificulta la planificación.

Casos de uso comunes de las API de Scraping web

Monitoreo de precios en el comercio electrónico

Los minoristas, las marcas y los proveedores de datos supervisan los precios de la competencia en Amazon, Walmart, eBay, Etsy y miles de mercados regionales. Los más de 437 Scrapers preconfigurados de Bright Data incluyen extractores estructurados para todas las principales plataformas de comercio electrónico, que devuelven el precio, la disponibilidad, las reseñas, los datos del vendedor y los metadatos del producto en JSON limpio sin necesidad de mantenimiento del selector. Los equipos también pueden acceder a conjuntos de datos de comercio electrónico recopilados previamente para omitir por completo el scraping en casos de uso estándar.

Recopilación de datos de redes sociales

El scraping de redes sociales implica algunos de los puntos finales más agresivamente protegidos de la web. LinkedIn, Instagram, TikTok, X y Facebook utilizan sistemas internos de detección de bots. La API Social Media Scraper de Bright Data gestiona perfiles de LinkedIn, páginas de empresas, publicaciones de Instagram, datos de creadores de TikTok, cronologías de X/Twitter y páginas públicas de Facebook, con una red de más de 150 millones de IPs residenciales que proporciona la confianza necesaria para evitar la detección a gran escala.

Extracción de datos inmobiliarios

El análisis inmobiliario requiere datos de Zillow, Redfin, Realtor.com, Booking.com, Airbnb y cientos de portales regionales. En la prueba independiente de Scrape.do, Bright Data alcanzó un 100 % de éxito en Zillow con un tiempo de respuesta de 2,1 segundos, el resultado más rápido de Zillow entre todos los proveedores probados. Su conjunto de datos inmobiliarios ofrece datos de listados estructurados sin necesidad de mantener ninguna infraestructura de scraping.

Datos de entrenamiento de IA y LLM

Las empresas de IA son el segmento de más rápido crecimiento del mercado del Scraping web. Proxyway informó de que Bright Data alcanzó los 300 millones de dólares de ingresos anuales recurrentes a finales de 2025, frente a los 100 millones de 2021, impulsado en gran medida por la demanda de IA. Según Cloudflare Radar, el 75 % de todo el tráfico web relacionado con la IA a mediados de 2025 se generó con fines de entrenamiento, no de inferencia o RAG. Bright Data presta servicios directamente a laboratorios de IA, desarrolladores de modelos y organizaciones de investigación, con una infraestructura diseñada para gestionar el rendimiento necesario para los procesos de entrenamiento continuo. Cada 15 minutos, los clientes de Bright Data extraen colectivamente datos suficientes para entrenar un gran modelo de lenguaje desde cero.

Supervisión de SERP

Las clasificaciones de búsqueda cambian a diario. Las marcas, las agencias de SEO y los equipos de Inteligencia competitiva necesitan acceso en tiempo real a las SERP de Google, Bing y Yandex en múltiples geografías. La API SERP de Bright Data ofrece datos estructurados de resultados de búsqueda (incluidos anuncios, fragmentos destacados, paquetes locales y resultados orgánicos) en todos los principales motores de búsqueda sin activar el filtrado basado en la ubicación geográfica. Para una comparación más amplia de las soluciones SERP disponibles, consulte este resumen de las principales API SERP.

Estudio de mercado del mercado laboral

Las empresas de tecnología de recursos humanos, los investigadores del mercado laboral y los agregadores de empleo dependen de los datos de Indeed, LinkedIn Jobs, Glassdoor, Monster y las bolsas de empleo regionales. Bright Data cuenta con Scrapers diseñados específicamente para cada una de estas plataformas. La combinación de extractores preconstruidos y una red de más de 150 millones de IPs residenciales lo convierte en la opción más fiable para obtener datos del mercado laboral a gran escala.

Datos financieros

Los datos financieros requieren una alta fiabilidad y claridad jurídica. La postura de cumplimiento normativo de Bright Data (RGPD, CCPA, ISO 27001, SOC 2) la convierte en la opción más defendible para las aplicaciones financieras empresariales. Zyte y Oxylabs también son opciones sólidas en este ámbito, especialmente para la extracción estructurada de fuentes de noticias financieras o documentos presentados ante la SEC a menor escala.

Rastreo académico y de investigación

Los investigadores y académicos suelen trabajar con volúmenes más reducidos y presupuestos más ajustados. El precio de entrada de 49 dólares al mes y la sencilla API de ScraperAPI lo hacen accesible para estudiantes e instituciones más pequeñas. Zyte ofrece un nivel gratuito muy adecuado para el scraping de investigación exploratoria. Para conjuntos de datos académicos más grandes, los conjuntos de datos pre-recogidos del mercado de conjuntos de datos de Bright Data pueden sustituir por completo al scraping, lo que permite a los equipos comprar datos estructurados directamente en lugar de crear un canal.

Principales retos técnicos y cómo resolverlos

Sistemas antibots

Las plataformas antibots modernas (Cloudflare, DataDome, Kasada, PerimeterX) operan a nivel de huella digital del navegador. Detectan navegadores sin interfaz, rangos de IP de centros de datos y patrones de comportamiento en milisegundos. En la referencia de Proxyway para 2025, Shein tuvo una tasa de éxito media del 21,88 % en todos los proveedores. La solución no es una lógica de scraping más inteligente. Es la diversidad de IP y la autenticidad de las huellas digitales. Las más de 150 millones de IPs residenciales de Bright Data proporcionan señales de confianza genuinas a nivel de pares que los Proxies de centros de datos no pueden replicar.

Resolución de CAPTCHA

Los retos CAPTCHA están diseñados para reducir a cero los costes de resolución manual para las máquinas. Una API de scraping sin capacidad para eludir CAPTCHA falla cada vez que se presenta un reto. El solucionador de CAPTCHA integrado de Bright Data gestiona automáticamente los retos estándar, basados en imágenes y de comportamiento, sin necesidad de un servicio CAPTCHA de terceros y sin intervención manual. En las pruebas de Scrape.do, Bright Data alcanzó el 100 % en Capterra, un dominio que requiere una gestión activa de CAPTCHA. Los equipos que evalúan herramientas independientes también pueden consultar esta comparación de los mejores solucionadores de CAPTCHA del mercado.

Sitios con mucho JavaScript

Las aplicaciones de una sola página creadas con React, Vue o Angular devuelven HTML vacío a las solicitudes HTTP estándar. El contenido real es inyectado por JavaScript después de la carga de la página. Cualquier API de Scraping web sin renderización completa de JavaScript no puede extraer datos significativos de estos sitios. Todos los proveedores de esta comparación admiten la renderización JS, pero el mecanismo es importante. La renderización JS de Bright Data se ejecuta a través del Navegador de scraping en un contexto de navegador genuino con huellas digitales auténticas, no con una firma de navegador sin cabeza detectable.

Bloqueo de IP y limitación de velocidad

Las IP de los centros de datos comparten rangos ASN que los sistemas antibots reconocen y bloquean a nivel de red. Los proxies rotativos de los centros de datos pueden agotar su pool de IP utilizables en cuestión de minutos en objetivos agresivos. Las IPs residenciales (asignadas a dispositivos de consumidores reales por los ISP) tienen historiales de uso legítimos que los sistemas antibots tratan como fiables. Las más de 150 millones de IPs residenciales de Bright Data proceden de dispositivos reales con patrones de uso genuinos, lo que proporciona las señales de confianza necesarias para eludir el bloqueo de nivel de operador.

Escala y concurrencia

La infraestructura de scraping interna se rompe a gran escala. Los límites de concurrencia, la infraestructura de reintentos, la gestión del conjunto de direcciones IP y el manejo de sesiones se convierten en proyectos de ingeniería por derecho propio. La infraestructura nativa de la nube de Bright Data maneja solicitudes masivas de hasta 5000 URL por llamada, gestiona la concurrencia automáticamente y se adapta a los volúmenes empresariales sin necesidad de aprovisionar infraestructura por parte del cliente.

Análisis de datos

El HTML sin procesar no es un dato. El parseo del HTML extraído en registros estructurados JSON, CSV o listos para bases de datos requiere una lógica de parseo que se rompe cada vez que se rediseña un sitio. Los más de 437 Scrapers preconstruidos de Bright Data gestionan el parseo automáticamente, y el equipo de ingeniería de Bright Data supervisa y actualiza los sitios cuando cambian los diseños. Los equipos que utilizan Scrapers preconstruidos reciben datos estructurados sin tener que mantener un solo analizador.

Cumplimiento

La recopilación legal de datos requiere procesos documentados, no solo buenas intenciones. El artículo 6 del RGPD exige una base legal para el tratamiento; la CCPA exige mecanismos de divulgación y exclusión voluntaria; los equipos de compras de las empresas exigen las certificaciones ISO 27001 o SOC 2 antes de firmar contratos. El Centro de confianza de Bright Data documenta su postura de cumplimiento en todos los marcos principales, el paquete de cumplimiento más completo disponible de cualquier proveedor en esta comparación.

Mantenimiento del Scraper

Los sitios web cambian constantemente su diseño, estructura HTML y comportamiento de carga. Cada cambio puede romper un Scraper personalizado de forma silenciosa, sin producir datos o produciendo datos incorrectos hasta que alguien se da cuenta. Bright Data supervisa automáticamente sus más de 437 Scrapers preconstruidos y envía actualizaciones cuando los sitios de destino cambian, eliminando por completo la carga de mantenimiento por parte del cliente. Los equipos que prefieren una adquisición de datos totalmente gestionada sin necesidad de poseer infraestructura pueden explorar el servicio gestionado de Bright Data como alternativa sin intervención.

Preguntas frecuentes

¿Cuál es la mejor API de Scraping web en 2026?

Bright Data es la mejor API de Scraping web en 2026. Alcanzó una tasa de éxito media del 98,44 % en la evaluación independiente de Scrape.do de 11 proveedores, el resultado más alto de todos los servicios probados. También alcanzó un éxito del 100 % en Indeed, Zillow, Capterra y Google individualmente. Ningún otro proveedor, ni en la evaluación comparativa de Scrape.do ni en la de Proxyway, igualó esa combinación de rendimiento máximo y medio.

¿Cómo funcionan las API de Scraping web?

Usted envía una solicitud al punto final de la API con una URL de destino. La API enruta la solicitud a través de una red de proxies gestionada, gestiona cualquier desafío CAPTCHA, renderiza JavaScript si es necesario, valida la respuesta y devuelve el contenido de la página, normalmente en formato HTML, JSON o CSV. Toda la rotación de proxies, la gestión de sesiones, la huella digital y la lógica de reintento se producen automáticamente dentro de la API. Usted recibe datos limpios; la API absorbe la complejidad de la infraestructura.

¿Cuál es la diferencia entre un Proxy y una API de Scraping web?

Un proxy enruta su solicitud a través de una dirección IP diferente, pero el rastreo, el parseo, el manejo de CAPTCHA, la representación de JavaScript y la lógica de reintento siguen siendo totalmente su responsabilidad. Una API de scraping web se encarga de todo: rotación de proxies, evasión de bots, representación, parseo y entrega de datos estructurados. Bright Data ofrece ambas cosas: una red de más de 150 millones de Proxies residenciales para equipos que desean acceso directo a la infraestructura, y una API de Scraping web completa para equipos que desean que se gestione todo el stack por ellos.

¿Cuánto cuesta una API de Scraping web?

Los precios varían significativamente según el proveedor y el nivel de funciones. Bright Data comienza en 1,50 $ por cada 1000 solicitudes exitosas sin compromiso mensual. Zyte comienza en aproximadamente 1,01 $ por cada 1000 solicitudes para objetivos fáciles, pero aumenta considerablemente para sitios protegidos. ScrapingBee, Oxylabs y ScraperAPI cuestan a partir de 49 $ al mes. Decodo cuesta a partir de 29 $ al mes. ZenRows cuesta a partir de 69 $ al mes. Para todos los proveedores basados en créditos, el coste efectivo por solicitud aumenta cuando se requiere renderización JavaScript o Proxy premium, a veces entre 5 y 75 veces.

¿Qué API de scraping web tiene la mayor tasa de éxito?

Bright Data, con una tasa de éxito media del 98,44 % en la evaluación independiente de Scrape.do de 11 proveedores. Alcanzó un éxito del 100 % en Indeed, Zillow, Capterra y Google. En la evaluación de Proxyway de 2025, Zyte lideró ese estudio con una tasa de éxito del 93,14 % en 15 sitios muy protegidos.

¿Las API de Scraping web pueden eludir Cloudflare?

Sí. Las mejores API de scraping web utilizan la rotación de IPs residenciales y la gestión de huellas digitales del navegador para eludir los sistemas de detección de bots de Cloudflare. Bright Data, Zyte y Oxylabs eluden sistemáticamente Cloudflare en los dos estudios comparativos citados en este artículo. Los proveedores que dependen de proxies de centros de datos o de pequeños grupos de IP son más propensos a ser bloqueados, especialmente en sitios donde Cloudflare está configurado de forma agresiva.

¿Es Bright Data la mejor API de Scraping web?

Según datos de referencia independientes, sí. La tasa de éxito media del 98,44 % de Bright Data es la más alta registrada en la prueba de 11 proveedores de Scrape.do, y su red (más de 150 millones de IP), la cobertura de scrapers preconfigurados (más de 437 sitios) y su postura de cumplimiento normativo (Cumplimiento GDPR, CCPA, ISO 27001, SOC 2) y garantías de fiabilidad (SLA con un tiempo de actividad del 99,99 %) no tienen rival entre los competidores incluidos en esta comparación. El único caso en el que otro proveedor podría ser más adecuado es el rastreo a pequeña escala o con un presupuesto limitado de sitios web con poca protección, en el que Decodo o ScrapingBee ofrecen unos costes de entrada más bajos.

¿Cuál será el valor del mercado del Scraping web en 2026?

Según Mordor Intelligence, el mercado global del Scraping web se valoró en 1030 millones de dólares en 2025 y se prevé que alcance los 2230 millones de dólares en 2030, impulsado principalmente por la demanda de datos para IA, la inteligencia de comercio electrónico y la monitorización de SERP. El Scraping web impulsado por IA está creciendo a una tasa de crecimiento anual compuesta del 39,4 % hasta 2029 (TechNavio).